Interaktive 3D - Modelle der Kleinfunde

HowTo

2. Mit gedrückter linker Maustaste bewegen Sie das Modell. Mit dem Mausrad zoomen Sie.

3. Wählen Sie unterschiedliche Darstellungen (z.B. Textur, Punktwolke etc.)

4. Mit "Enlarge" öffnen Sie die vergrößerte Ansicht.

5. Sie können mit SD und HD zwischen Standard und hoher Auflösung wählen.

Methodik, Details und technischer Hintergrund

(Text: Stefan Eichert und Ronny Weßling)

Einen wichtigen Teilbereich des Projekts stellt die Untersuchung der Buntmetallindustrie dar. Wie vorangegangene Projekte[1] gezeigt haben, ändern sich die Kupferlegierungen im Lauf der Zeit teilweise gravierend, was mit kulturellen, wirtschaftlichen und politischen Entwicklungen einhergeht. Auch der Frage nach dem Hintergrund der zahlreich in vorgroßmährischem Kontext angetroffenen, sogenannten „awarischen Bronzen“[2] außerhalb des eigentlichen awarischen Siedlungsgebiets soll anhand von naturwissenschaftlichen Analysen nachgegangen werden[3]. Dazu wird eine große Anzahl an Originalfunden vom Projektteam untersucht.

Abb. 1: Eine Auswahl der dokumentierten Buntmetallfunde aus Lány (CZ), ohne Maßstab. Fotos: Abteilung für Archäologie und Museologie der Masaryk Universität Brno

Es handelt sich um Buntmetallfunde aus dem tschechischen Lány in den Thayaauen, nahe der österreichischen Grenze bei Bernhardsthal sowie um entsprechende Funde auf österreichischer Seite[4].

Die Funde haben daher mehrere, unterschiedliche Verwahrorte. Auch die Zeitspannen, während derer die Funde für die Analyse zur Verfügung standen, waren begrenzt. Eine einheitliche und präzise Dokumentation war daher ein wichtiges Kriterium für die Durchführung der Studie. Zu diesem Zweck wurden dreidimensionale, digitale Modelle der Objekte erstellt.

Diese Vorgehensweise hatte im Wesentlichen vier Ziele: Zum Einen sollten die 3D-Modelle die händische, zeichnerische Dokumentation ersetzen. Zum Anderen konnten damit auch nach Rückgabe der Funde noch Vermessungen durchgeführt werden und Detailfragen anhand der digitalen Kopie des Originals besprochen werden. Darüber hinaus sollten die Modelle der interaktiven und zeitgemäßen Visualisierung und Kommunikation der Forschungsinhalte und -ergebnisse dienen. Zudem, war es uns auch ein Anliegen, gewissermaßen als „proof of concept“ einen Workflow zu entwickeln und Methoden zu erproben, über die das physische Objekt digitalisiert werden und in weiterer Folge in einer ansprechenden Form der Forschung und der interessierten Öffentlichkeit vermittelt werden kann.

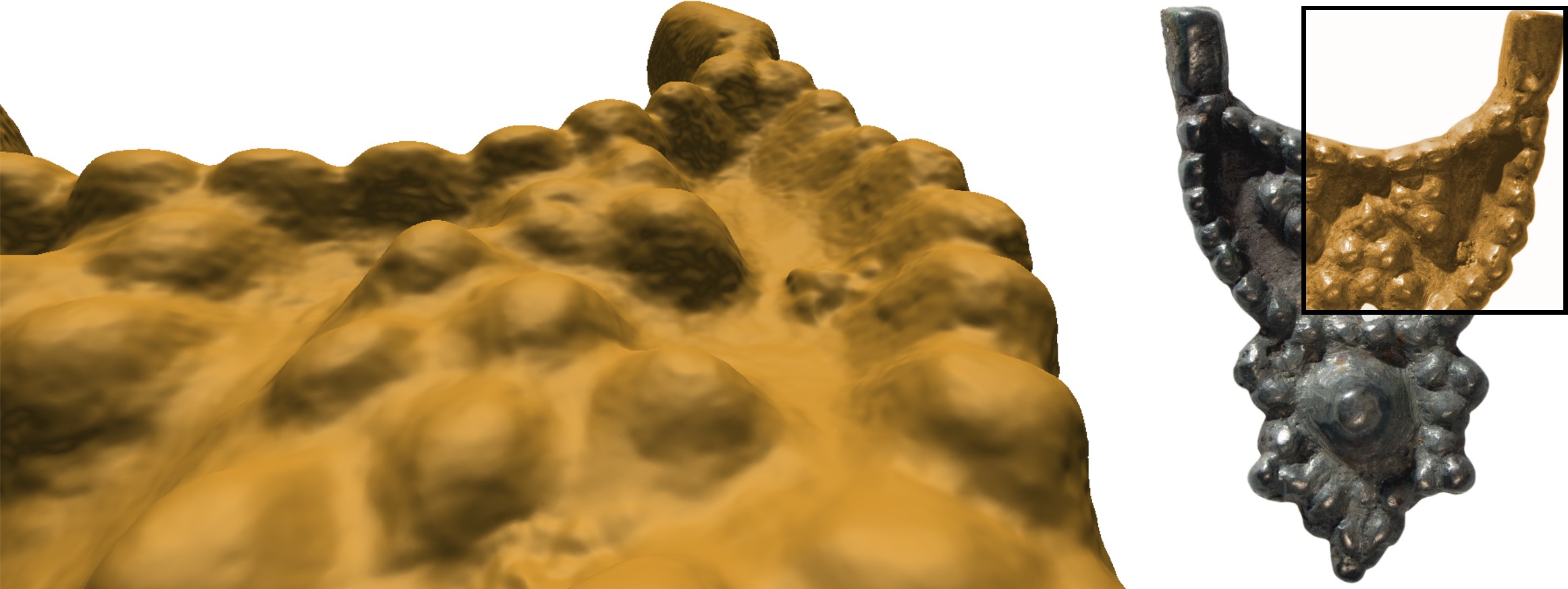

Abb. 2: Ohrgehänge aus Lány (CZ). Im stark vergrößerten 3D-Modell ist hier beispielsweise erkennbar, dass die „Kügelchen“ mitgegossen und nicht granuliert sind. Grafik: Verfasser.

2. Methodik

Zur dreidimensionalen Aufnahme von Objekten steht mittlerweile ein umfangreiches Methodenspektrum zur Verfügung. Grundsätzlich lassen sich dabei aktive und passive Methoden unterscheiden[5]. Während bei aktiven Aufnahmemethoden zumeist die Reflexion einer vom Scanner emittierten elektromagnetischen Welle aufgezeichnet wird, verarbeiten passive Methoden lediglich Informationen, die das Objekt ohne Penetrierung durch das Messgerät abgibt. Nahbereichslaser[6] sowie das Streifenlichtscanning[7] sind die am häufigsten eingesetzten aktiven Messverfahren zur 3D-Digitalisierung archäologischer Funde. Doch auch passive Verfahren aus den Bereichen der Fotogrammetrie und des Maschinellen Sehens (Computer Vision) finden immer häufiger Verwendung. Hervorzuheben ist hier unter anderem die Arbeit von Benjamin Štular und Seta Štuhec, die das Shape-from-Silhouette-Verfahren zur Präsentation frühmittelalterlicher Ohrringe aus Kranj erfolgreich zur Anwendung gebracht haben[8]. In der Praxis erfolgt die Auswahl der verwendeten Technik unter den Gesichtspunkten des gewünschten Ergebnisses, der benötigten Genauigkeit, der Objektmaße und Beschaffenheit, den Standortbedingungen, der Instrumentenverfügbarkeit, der persönlichen Erfahrung und dem zur Verfügung stehenden Budget. So konnten etwa die Ohrringe aus Kranj nicht mithilfe des bekannteren Structure-from-Motion- und Multi-View-Stereo-Verfahrens (SfM und MVS) dokumentiert werden, da die nur sehr geringe, zum Teil glänzende und monochrome Oberfläche der äußerst dünnen und fragilen Drahtbügel es nicht zulässt, die Kamerapositionen und die 3D-Szene zu rekonstruieren. Die hier besprochenen Buntmetallfunde aus der March-Thaya Grenzregion, überwiegend Gürtelbeschläge, eignen sich hingegen sehr wohl für die dreidimensionale Erfassung mittels SfM und MVS. Dabei handelt es sich um ein automatisiertes Verfahren, dass es ermöglicht aus einander überlappenden zweidimensionalen Fotografien Informationen zu extrahieren, um den dreidimensionalen Raum der abgebildeten Szene zu rekonstruieren[9]. Die menschliche Fähigkeit räumliche Strukturen (structure) infolge einer relativen Bewegung (motion) zwischen Objekt und Betrachter wahrzunehmen, wird dabei auf die Ebene des Maschinellen Sehens übertragen[10]. Die erwähnte Relativbewegung führt zu einer Parallaxe, also einer scheinbaren Positionsänderung der Objektbestandteile innerhalb der Szene, wodurch ein Tiefeneindruck entsteht[11], aus dem eine dreidimensionale Rekonstruktion abgeleitet werden kann.

3. Datenaufnahmen und Verarbeitung

Die Qualität der durch die Anwendung von SfM und MVS generierten 3D-Modelle beruht einerseits auf der Bildqualität der zugrunde liegenden Fotos und andererseits auf der Einnahme der richtigen Kamerapositionen.

Die Buntmetallfunde aus der March-Thaya Grenzregion haben zumeist nur eine maximale Größe von wenigen Zentimetern, weshalb eine formatfüllende fotografische Aufnahme derselben in den Bereich der Makrofotografie fällt[12]. Für kleine und filigrane Objekte ist eine Makroaufnahme nicht nur für eine hohe Modellauflösung[13] obligatorisch, sondern ein möglichst großer Abbildungsmaßstab ist auch zwingend notwendig um auf den Schmalseiten eines Objektes genügend korrespondierende Bildmerkmale für die Bildorientierung zu extrahieren. Obwohl sich das SfM- und MVS-Verfahren auch in der Archäologie zunehmender Beliebtheit erfreut[14], gibt es bisher wenige Beispiele für makrofotografisch gestützte Modellierungen von Fundmaterial[15].

Dies liegt vermutlich nicht zuletzt an der geringen Schärfentiefe von Makroaufnahmen, das heißt, nur ein kleiner Bereich des Objektes wird tatsächlich scharf abgebildet. Dabei gilt, dass je kürzer die Gegenstandsweite ist, desto größer sind Abbildungsmaßstab und Bildauflösung und desto geringer ist die Schärfentiefe. Zur Vergrößerung der Schärfentiefe wird üblicherweise die Blende der Kamera möglichst weit geschlossen. Das Abblenden ist jedoch durch den Effekt der Beugungsunschärfe limitiert[16]. Für die verwendete Kamera (Canon EOS 600D mit APS-C Sensorformat und Canon 60mm f/2.8 USM Makroobjektiv) ergibt sich ein sogenannter Sweet Spot bei f/16. Bei einer durchschnittlichen Gegenstandsweite von 22 cm beträgt die Schärfentiefe 0,59 cm, was bei Schrägaufnahmen zur Folge hat, dass nur ein Teil des Objektes scharf dargestellt wird. Da die verwendeten SfM und MVS-Algorithmen in unscharfen Bildbereichen nur sehr wenige korrespondierende Bildmerkmale extrahieren können, führt dies entweder zu einem Rauschen an der Oberfläche des Modells oder sogar dazu, dass eine Modellberechnung unmöglich ist. Für eine Erweiterung der Schärfentiefe wurde teilweise auf die Technik der Fokusvariation zurückgegriffen, bei der eine Bildserie mit unterschiedlichem aber überlappendem Schärfentiefebereich aufgenommen und im Anschluss zu einem Einzelbild mit voller Schärfentiefe montiert wird[17]. Diese Vorgangsweise führte zu sehr guten Ergebnissen, ist jedoch recht zeitaufwendig.

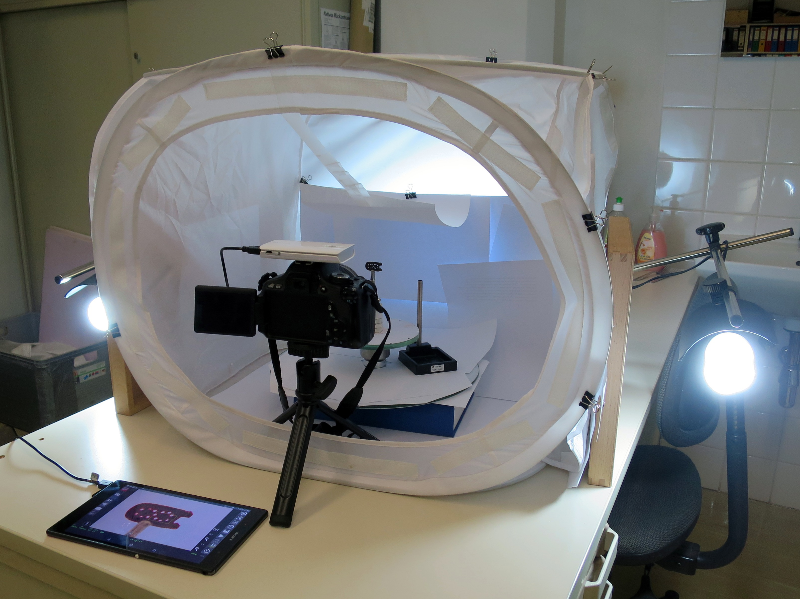

Ein weiteres Problem, nicht nur der Makrofotografie sondern beinahne aller bildbasierten Aufnahmetechniken, stellen glänzende Oberflächen dar, die je nach Betrachtungswinkel und Lichteinfall zu unterschiedlichen Reflexionen führen. Sie sind die Hauptursache für ein Rauschen der Modelloberfläche, das heißt eine ursprünglich glatte Oberfläche wird als raue mit Spitzen versehende Fläche rekonstruiert. Um Reflexionen zu verhindern lässt sich das Objekt mit einem Überzug bzw. Anstrich versehen. Eine weitere Möglichkeit besteht in der Modifikation der Beleuchtung, die entweder direkt am Objekt oder mittels High-Dynamik-Range-Aufnahmen (HDRI) indirekt am aufgenommenen Bild vorgenommen werden kann. Ein Polarisationsfilter hingegen kann Reflexionen metallischer Oberflächen nicht verringern[18]. Da ein Überzug der Objekte einerseits aus konservatorischen Gründen bedenklich sein kann und andererseits auch die Texturinformationen verfälscht und HDR-Aufnahmen sowohl zeitaufwendig sind als auch eher wenig Reflexionsreduzierungen bewirken, wurde im Rahmen der Aufnahmen mit möglichst diffusem und weitestgehend reduziertem Lichteinfall gearbeitet. Dazu wurden herkömmliche Tageslichtlampen sowie ein zusätzlich abgedunkeltes Lichtzelt verwendet.

Abb. 3: Ein Blick auf das zur Datenaufnahme verwendete Equipment. Foto: Verfasser

Bei stark reflektierenden Objekten wurde teilweise für jede Aufnahme eine auf das Objekt abgestimmte Beschattung durchgeführt. Die Aufnahmen selbst sind mithilfe eines Stativs entstanden, das Objekt stand zentral auf einem Drehteller, welcher nach jedem Foto um 15 Grad weitergedreht wurde. Dadurch werden ein regelmäßiger Objektabstand sowie eine gleichmäßige konvergente Bildüberlappung garantiert. Nach einer vollen Umdrehung des Drehtellers, wird das Objekt um 90 Grad gedreht, damit auch die Standfläche bzw. jener Bereich, der durch die Objekthalterung verdeckt wurde, fotografiert werden kann. Für eine hochqualitative und zuverlässige Oberflächenmodellierung ist es nötig, dass sich möglichst viele Bilder überlappen um die Berechnung der jeweiligen Kamerapositionen wechselseitig zu optimieren, weshalb bei komplexer Objektgeometrie eine dritte konzentrische Bildsequenz angefertigt wurde, die im 45 Grad Winkel zu den beiden übrigen Durchläufen steht.

In Summe ergeben sich damit bis zu 72 Aufnahmen, die in der kommerziellen Software Agisoft PhotoScan zu einem 3D-Modell prozessiert werden[19].

Innerhalb der Software erkennen spezielle Algorithmen automatisiert markante Bildpunkte und berechnen daraus die Kameraposition. Bei nun bekanntem Kamerastandpunkt kann durch die Einbeziehung von Abstand und Winkel zwischen Bildpunkten und Aufnahmestandort die 3D-Position sämtlicher markanter Bildpunkte berechnet und als lichte Punktwolke in den Raum projiziert werden. Die Bildpunkte sind in einem lokalen Koordinatensystem positioniert, weshalb die Modelle erst skaliert werden müssen. Dies geschieht, indem die Distanzen zwischen frei definierten Referenzpunkten des Originalobjektes manuell gemessen und auf das virtuelle Objekt übertragen werden[20]. Zur Generierung eines präzisen texturierten 3D-Modells wird die dünne Punktwolke unter Hinzuziehung von Multi-View-Stereo Algorithmen auf der Pixelebene verdichtet. Die resultierende dichte Punktwolke wird im Anschluss zu einer Oberfläche vermascht.

Trotz der Unterdrückung von Lichtreflexionen kommt es partiell, insbesondere an Umbruchkanten des Objektes, zu einem erhöhten Auftreten von Oberflächenrauschen. Derartiges Rauschen kann bis zu einem gewissen Grad entweder in der zugrunde liegenden Punktwolke oder aber im vermaschten Modell herausgefiltert werden. Aufgrund begrenzter Importmöglichkeiten innerhalb von Agisoft PhotoScan wurde im Zuge dieser Studie das vermaschte Modell in der Software Geomagic Studio geglättet. Dabei kommen verschiedene Filter zur Anwendung, die unter anderem darauf ausgerichtet sind, statistische Ausreißer zu eliminieren, ohne aber die Detailtreue des Modells zu minimieren. Das derart gefilterte Modell wird nun wiederum in Agisoft PhotoScan importiert um die Originaltextur der Fotos auf die Oberfläche zu projizieren.

Als Endprodukt liegt damit eine proprietäre .psz-Datei vor, aus der sich alle gängigen 3D-Formatdateien wie Wavefront .obj oder Collada .dae exportieren lassen.

4. Visualisierungen der Modelle

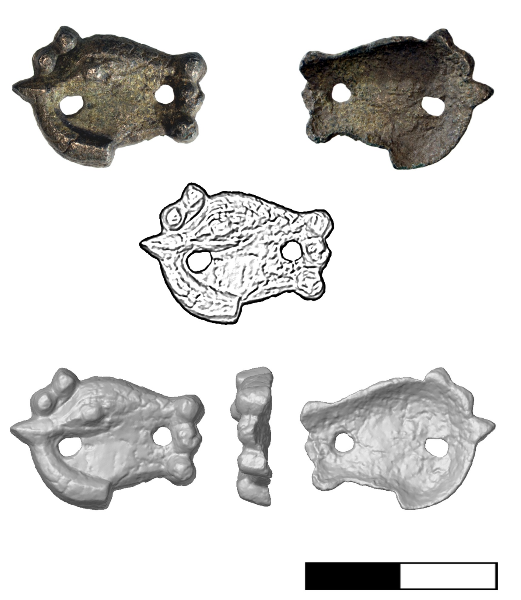

Mit den nun zur Verfügung stehenden 3D-Modellen sollten in weiterer Folge die eingangs besprochenen Ziele verwirklicht werden. Als Vorbild für die grafische Dokumentation diente uns die Visualisierung einer awarischen Riemenzunge aus Bruckneudorf[21]. Diese wurde fotografisch, als Strichzeichnung, in Halbtontechnik sowie als gerendertes 3D-Modell im Stil der Halbtontechnik dokumentiert. Für uns war besonders der letzte Punkt von Bedeutung. Um eine solche Darstellung der 3D-Modelle zu erhalten, wurden diese mit der Software Meshlab und mit dem dort integrierten Shader „lattice“ so gerendert, dass das Ergebnis einer Zeichnung in Halbtontechnik entsprach. Dabei wurde jeweils eine orthogonale Ansicht jeder Seite des Objekts angefertigt und diese dann als Rastergrafik gespeichert. In der Bildbearbeitungssoftware Gimp wurden die einzelnen Ansichten zusammengefügt und skaliert, sodass ein maßstabsgetreues Abbild des Funds als Entsprechung einer technischen Zeichnung entstand. Basierend auf diesen Abbildungen konnten nun in weiterer Folge Tafeln erstellt werden. Des Weiteren wurde über das automatisierte Erkennen von Konturen versucht, ein der Strichzeichnung entsprechendes, grafisches Ergebnis zu erhalten.

Abb. 4: Visualisierung eines Zaumzeugbeschlags aus Lány (CZ) in unterschiedlichen Varianten. Grafik: Verfasser, Foto: G. Gattinger, IUHA.

5. Interaktive Präsentation

In den letzten Jahren ist es unabdingbar geworden, neben den klassischen Veröffentlichungsmethoden, archäologische Inhalte und Ergebnisse auch digital, interaktiv und webbasiert zu präsentieren. Zahlreiche Institute, Museen und Projekte haben diesen Weg bestritten und speziell archäologische Funde werden oftmals als interaktive 3D-Modelle im Netz präsentiert[22]. Einerseits gibt es dafür kommerzielle Anbieter wie z.B. p3d.in[23], sketchfab[24] oder verold[25], die für private Zwecke teilweise kostenlose Pakete zum Hosten von 3D-Modellen im Web anbieten, was auch von einigen archäologischen Initiativen verwendet wird[26]. Andererseits gibt es neben proprietärer und kostenpflichtiger auch kostenfreie open Source Technologie zum Präsentieren von 3D-Inhalten im Netz innerhalb der eigenen technischen Infrastruktur.

Die nun erstellten 3D-Modelle sollten auf der Website des eingangs erwähnten Projekts präsentiert werden. Dafür wurde der open Source 3D-viewer „jsc3d“ verwendet. Es handelt sich dabei um einen rein in Javascript geschriebenen Viewer, der alle gängigen Browser sowie WebGL unterstützt und HTML-Canvas verwendet. Er ist auf herkömmliche Bildschirme ebenso wie auf mobile Geräte mit Touchdisplays zugeschnitten und kann Texturen, Drahtgitter, Oberflächen wie auch Punktwolken darstellen[27].

Allgemein ist zu sagen, dass die Qualität von webbasierten 3D-Darstellungen von mehreren Faktoren abhängig ist, die sich gegenseitig beeinflussen. Eine große Detailgenauigkeit des 3D-Modells, also eine hohe Anzahl an Polygonen bzw. Punkten und eine hochauflösende Textur, bringen eine höhere Dateigröße mit sich, was wiederum längere Ladezeiten bedeutet und auch die Performance, also die flüssige Darstellung des Modells, ist erschwert. Geringerer Detailgrad bedeutet andererseits Informationsverlust. Als Kompromiss wird oft eine höher aufgelöste Textur auf ein Modell mit geringer Polygonanzahl gemapped. Durch den Schattenwurf in der Fototextur wird zusätzlich ein dreidimensionaler Eindruck vermittelt, der aber de facto im Modell gar nicht gegeben ist.

Abgesehen davon gibt es zahlreiche Dateiformate für 3D-Modelle, die sich besonders in puncto Dateigröße unterscheiden, auch wenn die Qualität vergleichbar ist. Das hier abgebildete Beispiel der Riemenzunge mit der Schlangendarstellung weist rund 410.000 Punkte (Vertices) und knapp 80.000 Polygone (Faces) auf. Im gängigen Wavefront Format .obj beträgt die Dateigröße 90 Mb ohne Texturdatei. Im Collada Format .dae kommt die Datei auf knapp 70 Mb. Für das Projekt wurde das open Source Format OpenCTM .ctm verwendet[28]. Dabei beträgt die Dateigröße bei komplett verlustfreier Speicherung in gleicher Qualität lediglich 2,8 Mb. Die Textur hat als 26 Megapixel JPEG-Datei (5100x5100 Pixel) mit einer Kompression auf 90% eine Größe von 2,6 Mb.

Statt in Summe rund 93 Mb beim .obj Format müssen hier also nur 5,4 Mb übertragen werden, was erheblich kürzere Ladezeiten mit sich bringt. Bei einer Polygonanzahl von 10.000 beträgt die Dateigröße im OpenCTM Format lediglich 405 Kb, die Textur mit 26 Megapixel hat bei 50% Kompression eine Größe von 950 Kb, wobei hier mit freiem Auge kein Qualitätsunterschied im Webbrowser erkennbar ist. Bei einer normalen Internetverbindung ist das kleinere Modell also innerhalb einer Sekunde geladen, das größere und extrem hoch aufgelöste innerhalb weniger Sekunden. Der für das Projekt adaptierte Viewer erlaubt dem Benutzer das stufenlose Scrollen und Navigieren und die Auswahl unterschiedlicher Darstellungen (Textur, Oberfläche, Punktwolke und Drahtgitter) und Qualitäten.

6. Resümee

Anhand des vorgestellten Projekts sollte besprochen werden, welche Gründe beim Erstellen von digitalen 3D-Modellen eine Rolle spielen und welche Anwendungsmöglichkeiten es in Folge für diese gibt. Unterschiedliche Methoden für die Digitalisierung wurden vorgestellt, die von uns verwendete im Detail. Auch wurden die Möglichkeiten der grafischen Visualisierung sowie der interaktiven Visualisierung im WWW diskutiert.

Unterschiedliche Methoden haben dabei unterschiedliche Vor- und Nachteile. Für ein optimales Ergebnis ist eine intensive Vorbereitung und Auswahl der zu verwendenden Techniken essentiell, um das beste Verhältnis zwischen zeitlichem, technischem bzw. finanziellem Aufwand und der Qualität des Ergebnisses zu erhalten.

Literatur

S. Eichert & M. Mehofer 2011: Frühmittelalterliche Emailscheibenfibeln aus Villach. Archäometallurgie und experimentelle Archäologie. Neues aus Alt Villach 48, 2011, 29–66.

S. Eichert & M. Mehofer 2013: Recyclete Römer oder slawische Metallurgen? Interdisziplinäre Studien zur frühmittelalterlichen Buntmetallindustrie im Ostalpenraum. Archäologie Österreichs 24/2, 2013, 46–54.

S. Eichert & E. Nau 2011: Experimente zu Eisenverhüttung, Buntmetallguss und Email des Frühmittelalters im Bajuwarenhof Kirchheim. Bajuwarenhof Kirchheim. Projekt für lebendige Archäologie des Mittelalters. Jahresschrift 2010, 2011, 6–26.

J. Frána & A. Maštalka 1992: Röntgenfloureszenzanalyse von frühmittelalterlichen Bronzen aus Böhmen und Mähren. In: F. Daim (Hrsg.), Awarenforschungen II. Archaeologica Austriaca Monographien 2, Wien 1992, 779–801.

G. Godin, J.-A. Beraldin, J. Taylor, L. Cournoyer, M. Rioux, S. El-Hakim, R. Baribeau, F. Blais, P. Boulanger, J. Domey & M. Picard 2002: Active optical 3D imaging for heritage applications. IEEE Computer Graphics and Applications, 22 (5), 24–35.

G. Guidi & F. Remondino 2012: 3D Modelling from Real Data. In: C. Alexandru (Hrsg.), Modeling and Simulation in Engineering. InTech, 69–102.

G. Guidi, S. Gonizzi Barsanti, L. L. Micoli & M. Russo 2014a: Massive 3D Digitization of Museum Contents. In: L. Toniolo, M. Boriani, and G. Guidi (Hrsg.), Built Heritage: Monitoring Conservation Management, Cham 2014, 335–346.

G. Guidi, S. Gonizzi Barsanti & L. L. Micoli 2014b: Image pre-processing for optimizing automated photogrammetry performances. ISPRS Annals of the Photogrammetry, Remote Sensing and Spatial Information Sciences 2014, Volume II-5, 145–152.

F. Humer, M. Pregesbauer, F. Vermeulen, C. Corsi & M. Klein 2010: 3D culture database Carnuntum. In: M. Ioannides, D. Fellner, A. Georgopoulos, & D. Hadjimitsis (Hrsg.), Digital heritage: proceedings of the 3th international conference dedicated on digital heritage. Presented at the 3th International conference on Digital Heritage (Euromed 2010), 91–93.

K. Kraus 2004: Photogrammetrie. Band 1 – Geometrische Informationen aus Photographien und Laserscanneraufnahmen. Berlin 2004.

D. G. Lowe 1999: Object recognition from local scale-invariant features. Proceedings of the International Conference on Computer Vision 1999, Vol. 2, 1150–1157.

M. Potenziani, M. Callieri, M. Dellepiane, M. Corsini, F. Ponchio & R. Scopigno 2015: 3DHOP: 3D Heritage Online Presenter. Computers & Graphics 52, 2015, 129–141.

F. Sauer, M. Abd El Karem & T. Pils 2013: Fundstelle Bruckneudorf. Das awarische Gräberfeld. Die archäologischen Grabungen auf der Trasse der A6. Innsbruck 2013.

S. Scherer 2007: Focus-Variation for optical 3D measurement in the micro- and nano-range. In: N. Bauer (Hrsg.), Handbuch zur industriellen Bildverarbeitung. Stuttgart 2007, 198–210.

M. Schreiner, A. Schaffer, P. Spindler, P. Dolezel & F. Daim 2000: Materialanalytische Untersuchungen an Metallobjekten möglicher byzantinischer Proveninenz. In: F. Daim (Hrsg.), Die Awaren am Rand der byzantinischen Welt. Studien zu Diplomatie, Handel und Technologietransfer im Frühmittelalter. Monographien zur Frühgeschichte und Mittelalterarchäologie 7, Innsbruck 2000, 283–303.

S. B. Steinman, B. A. Steinman & R. P. Garzia 2000: Foundations of Binocular Vision: A Clinical perspective. New York 2000.

B. Štular & S. Štuhec 2015: 3D Archaeology: Early Medieval Earrings from Kranj. - ZRC Publishing, Ljubljana.

R. Szeliski 2010: Computer Vision: Algorithms and Applications. London 2000.

G. Verhoeven, C. Sevara, W. Karel, C. Ressl, M. Doneus & C. Briese, 2013: Undistorting the past – New techniques for orthorectification of archaeological aerial frame imagery. In: C. Corsi, B. Slapšak und F. Vermeulen (Hrsg.): Good practice in archaeological diagnostics. Non-invasive survey of complex archaeological sites. Natural Science in Archaeology, 31–67.

R. Weßling, J. Maurer & A. Krenn-Leeb 2014: Structure from Motion for systematic single surface documentation of archaeological excavations. In: Museen der Stadt Wien – Stadtarchäologie (Hrsg.) Proceedings of the 18th International Conference on Cultural Heritage and New Technologies (CHNT 18, 2013), Vienna 2014.

H. Yanagi & H. Chikatsu 2010: 3D modelling of small objects using macro lens in digital very close range photogrammetry. International Archives of Photogrammetry, Remote Sensing and Spatial Information Sciences, Vol. XXXVIII-5,617–622.

J. Zábojník 2005: Mikulčice - awarische Stadt?. In: P. Kouřil (Hrsg.), Die frühmittelalterliche Elite bei den Völkern des östlichen Mitteleuropas. Spisy archeologického ústavu AV ČR Brno 25, Brno 2005, 101–114.

J. Zábojnik 2011: Zum Vorkommen von Gegenständen "awarischer" Proveninenz auf den slawischen Burgwällen nördlich der Donau. In: J. Macháček & Š. Ungerman (Hrsg.), Frühgeschichtliche Zentralorte in Mitteleuropa. Studien zur Archäologie Europas 14, Bonn 2011, 203–216

[1] Eichert & Mehofer 2013; Eichert & Mehofer 2011; Eichert & Nau 2011. Hier konnte beispielsweise herausgearbeitet werden, dass relativ inhomogene Kupfer-Blei-Zinn-Legierungen ab dem 9. Jahrhundert im Ostalpenraum von sehr einheitlichen Kupfer-Zink-Blei-Legierungen abgelöst wurden. Falko Daim hat innerhalb des awarischen Fundguts bereits darauf hingewiesen, dass mit der fortschreitenden Spätawarenzeit vermehrt Blei auf Kosten des Kupfers beigemengt wird. Vgl. Schreiner et al. 2000. Siehe auch: Frána & Maštalka 1992.

[2] In einigen Fällen ist der Begriff „Bronzen“ technisch gesehen falsch, da es sich teilweise auch um Messing, also um Kupfer-Zink-Legierungen ohne Zinnanteil handelt.

[3] Zábojnik 2011; Zábojník 2005.

[4] An dieser Stelle sei Jiří Macháček und seinem Team für die Bereitstellung der Funde und bisheriger Messergebnisse herzlich gedankt. Ebenso gilt unser Dank Herrn Friedel Stratjel vom Museum Bernhardsthal. Die Messungen wurden und werden in Wien mit einem Rasterelektronenmikroskop am VIAS (Vienna Institute for Archaeological Science) von Mathias Mehofer durchgeführt, dem an dieser Stelle auch herzlich gedankt sein soll. Des Weiteren werden ausgewählte Stücke mittels Bleiisotopenanalysen noch detaillierter auf ihre Materialherkunft analysiert.

[5] Guidi & Remondino 2012, 70.

[6] z. B. Humer et al. 2010.

[7] z. B. Godin et al. 2002.

[8] Štular & Štuhec 2015.

[9] Szeliski 2010, 21.

[10] Lowe 1999, 1156.

[11] Steinman et al. 2000, 2–5.

[12] Bei Abbildungsmaßstäben von etwa 1:5 bis 1:1 spricht man von Makrofotografie.

[13] Die im Rahmen der Studie erstellen Modelle haben eine durchschnittliche Auflösung von 15 µm.

[14] z. B. Weßling et al. 2014.

[15] z. B. Yanagi & Chikatsu 2010.

[16] Kraus 2004, 68.

[17] Vgl. Scherer 2007. - Zur Vergrößerung der Schärfentiefe könnte auch eine Kamera mit kleinerem Bildsensor verwendet werden. Dies würde jedoch wiederum den Abbildungsmaßstab verringern.

[18] Guidi et al. 2014b, 151.

[19] Einen guten Überblick über den verwendeten SfM- und MVS-Workflow liefert Verhoeven et al. 2014, 42–48.

[20] Für die Festlegung der Objektorientierung müssen insgesamt 3 Referenzpunkte, die auf einer Ebene und im rechten Winkel zueinander stehen, gewählt werden.

[21] Sauer et al. 2013, 87–89.

[22] In Österreich z.B. der Kulturpark Hengist: http://www.hengist-archaeologie.at/archaeologie/3d-objekte (01.10.2015); oder die Carnuntum 3D-Objektdatenbank: http://www.carnuntum-db.at/ (01.10.2015). Daneben gibt es selbstverständlich auch zahlreiche 3D-Rekonstruktionen von architektonischen Objekten bis hin zu ganzen Landschaften. Dieser Artikel beschäftigt sich aber in erster Linie mit archäologischen Kleinfunden. Vgl. dazu auch: Guidi et al. 2014a.

[23] http://p3d.in/ (01.10.2015).

[24] https://sketchfab.com/ (01.10.2015).

[25] https://www.verold.com/ (01.10.2015).

[26] z. B. http://www.crazyeye.at/ bzw. https://sketchfab.com/crazyeye (01.10.2015).

[27] https://code.google.com/p/jsc3d/ und https://github.com/humu2009/jsc3d (01.10.2015). Der speziell für den Cultural Heritage Bereich entwickelte Viewer/Presenter „3DHOP“ (http://www.3dhop.net/) (1.10.2015) unterstützt in der aktuellen Version noch keine Texturen. Vgl. Potenziani et al. 2015.

[28] http://openctm.sourceforge.net/ und http://openctm.sourceforge.net/media/FormatSpecification.pdf (01.10.2015).